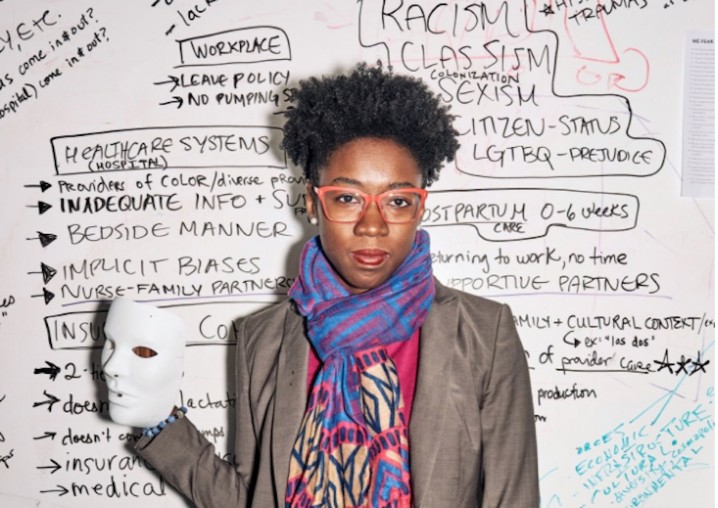

這並非電腦本身是種族歧視份子,根據麻省理工媒體實驗室 Joy Buolamwini 的一項研究,非白人辨識率較低是源於訓練面部辨識功能時,向系統提供的數據和製作演算法的環境所致。為了避免問題出現,研究員 Buolamwini 正努力推動「演算法問責制」,希望軟件工程師和開發人員令系統作出的自動化決定更透明、公平和能夠解釋。

面部辨識技術辨認白人時曾角度達 99%,但相片中人的膚色越深,出錯率就會越高,而最高可達 35%。Buolamwini 相信系統的偏見並非刻意為之,但她認為應該更加刻意挑選訓練人工智能軟件的材料,令到系統在辨識女性和有色人種時更加聰明。Buolamwini 的研究集中於 3 間有提供性別分類特徵,並讓公眾測試程式碼的機構:Microsoft、IBM 和 Megvii。

Buolamwini 將研究結果跟三間機構分享,最後 IBM 表示他們會改善面部分析軟件,並且在本月內改善服務;Microsoft 則表示會投資在研究方面,期望未來能夠分辨、了解和移除所有面部辨識的偏見,至於中國公司 Megvii 則未有就 Buolamwini 的研究作出回應。

資料來源:androidcommunity